不管过去还是现在,科学都是对一切可能的事物的观察。所谓先见之明,是对即将出现的事物的认识,而这认识要有一个过程。

——达·芬奇

在新一轮的人工智能浪潮下,“GPT”这个词时常会钻进我们的耳朵,而且随着chat GPT的爆火,再一次将人工智能与AI的无限能力呈现于世人眼前。而我们在惊叹高科技飞速发展的同时,前所未有的忧虑也随之而来,“高科技是否会取代人类”,“未来这几类人将会失业”……诸如此类的文章可谓是铺天盖地,看到不由得让人心头一紧,难道打败人类的,将是人类创造出的科技吗?

图片来源于网络

“GPT”到底是什么,又有何种能力?

其实GPT是一种先进的自然语言处理模型,通过大规模的自然语言数据训练,可以掌握和“学习”自然的语言表述方式和规律。GPT全称是(Generative Pre-trained Transformer),其中:“Generative”表示该模型具有生成文本的能力;“Pre-trained”指的是在对模型进行特定微调任务之前,会进行大量文本数据集的预训练;“Transformer”指的是该模型所用的基本架构。

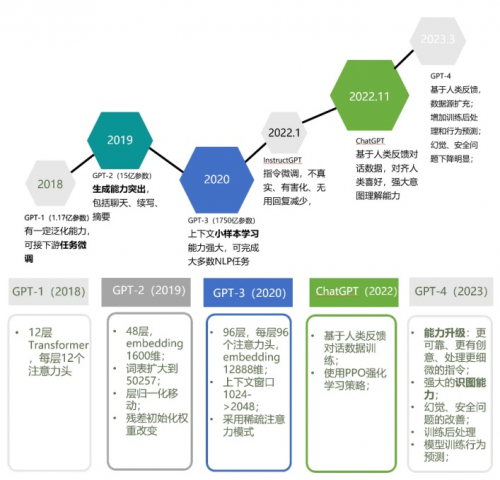

从发展历程上看,2017年出现的Transformer模型为GPT的出现奠定了基础,2018年GPT问世,由OpenAI提出的GPT-1开启了新一轮自然语言模型发展的热潮,生成式预训练模型GPT-1诞生。2019年,GPT-2以增加模型通用性为目标,移除GPT-1的微调,以更大的参数量和多任务训练,无需经过特定的数据集训练也能解决各类问题,即zero-shotlearning(零次学习)。2020年,GPT-3用Few-shot代替zero-shot,并将训练参数增加到1750亿,再次提高模型表现性能。2023年3月14日OpenAI推出了GPT-4模型,向多模态通用人工智能迈出了更加坚实的一步。

在GPT持续发展的历程中,其技术水平与能力得到了充分的提升,经历了数次升级迭代后,使得GPT-4拥有了以下特性:

强化的语言和代码生成:GPT-4可以生成更连贯的、类似人类的语言。代码生成也得到了改进。 对内容理解更完善:更容易理解句子的意思,并提供更多正确的回答。 多语言支持:支持多种语言。 多模式:支持文本和图像输入。 更长的上下文相关性:OpenAI API提供了相当于10-13页文本的8k和相当于约50页文本的32k版本,可供API使用。 图像理解(多模态):不仅能理解图片中的内容,还能理解上下文及其含义。

“光说不练假把式”,在实际的应用场景中,GPT也有着不俗的表现,例如在客服服务领域,能够通过对客户的查询提供即时响应来改善客户服务。在翻译领域,能够准确地将本文翻译成另一种语言。另外内容生成上,可以根据用户的需求,生成原创且连贯的内容。此外它在图片分析、总结、创意生成等领域也能提供极为出色的应用。值得业内同仁共同关注的是,GPT还能够生成代码,这对于程序员来说,虽然能够在一定程度上提升效率,但是从某些角度理解,或许也并不是一个“好消息”。说到底,GPT仍是一个工具,如何使用它决定了他的价值有多大。

谈到GPT的应用场景,近日在我们运营的社群内,群友G的一则提问与之极为相关,且该需求对于不同行业中的企业来讲,也是极为普遍的。

群友G提出:假如可以把GPT嵌入到企业微信中,成为企业AI,大家愿意部署吗?

她还作以补充说明,表示她目前的想法在于打造一个机器人,提升用户寻找资料的效率,正所谓“问度娘不如问AI”,因此是否可以考虑将GPT植入到企业微信中,供大家查询相关资料、学习某些知识使用。

这一问题的提出,引发了大家的广泛讨论,有人认为如果采用私有化部署方式,才能行的通。也有群友表示认为千万不要这样去做,有可能会导致信息泄密。综合来看,针对这样的做法,大多数群友持有的仍是保守的意见,主要的原因在于这一做法无法行之有效的保证信息安全。

的确鉴于人工智能的训练和学习方式,当员工使用GPT时,很可能会出现一些风险,例如工作中的保密和隐私问题、偏见和公平、法律合规性和责任等等,然而想要使用又必须突破这些难点。摆在面前的,就有两个矛盾点至今无法去妥善解决,第一就是部署方式的问题,采用私有化部署势必更加安全,但是带来的弊端就是数据量的局限性,无法获取到足够的数据量,AI的准确性又无从谈起,甚至可以说打造“私有化的AI”是无意义的。另外一个矛盾点就是数据跨境问题,有群友直言虽然可能GPT的接口是本地的,但是最后仍会提交到美国的服务器,数据出境问题不可避免,过程中难以保证数据安全,因此企业的重要机密也极有可能泄露,后果是无法想象的。

鉴于此,有的群友呼吁到:“我们还是等国内的吧,等百度,等阿里!”。

在群友们的期待中,也让我们看到了以ChatGPT为代表的内容生成型人工智能的崛起,是人工智能领域的一次重大变革。其通过引入新的训练方法,在降低人工智能使用门槛的同时,拓展了人工智能的应用领域,甚至使人工智能进入到了寻常百姓家,人工智能的通用化时代正在悄然而至。对于企业而言,GPT带来了新的发展机遇,但是其中所隐藏的风险也不容小觑,目前来看主要体现在以下几个方面:

隐私和数据安全风险。更强的算力,更优的算法,就意味着更大的隐私和数据风险。 偏见和歧视风险。如果说在公域数据上训练出来的GPT会有偏见和歧视的话,那么私域数据训练出来的GPT的偏见和歧视会更加明显,原因在于私域数据量比公域要小得多。 造假和作弊风险。好的工具也是一把双刃剑,滥用工具导致造假和作弊无法避免。 内容不确定性风险。GPT生成的内容已经很大程度上可以代替人类,但是无法避免其遇到盲点,难以保证信息质量,观点的偏颇。 监管和合规风险。使用GPT需要满足法律和监管要求。如果未经充分验证就使用GPT,就有可能触犯法律和监管规定。 战略和变革风险。GPT的应用一定会带来企业的巨大变革,这种变革首先是过程性的、职能性的,但最终必将是全面性的和战略性的。 员工岗位和能力丧失的风险。GPT可以高效优质地从事许多工作,不但能够在一定程度上帮助人类去完成一些工作,甚至可以完全替代很多一般岗位。

如何规避风险是必须慎重思考的,而想要发挥GPT的效用,也需要从两方面着手,一方面需要去养模型,另一方面是用模型,想要养模型就要有足够的数据来源,用好模型又需要强大的计算能力,因此对于企业来说,如何在保证安全的前提下,使GPT与现有的应用场景结合?在实际应用后,又能为企业带来多大的效率提升?其价值难以量化,因此很多企业认为当下对于GPT进行深入应用似乎并未到达一个成熟的时机。

如果将GPT想象成一个真实的人,其强大的记忆力与推理能力是超乎想象的,而真正使得GPT超越其他大模型之处就是可以实现真正的个性化学习!无疑GPT是人工智能领域令人惊喜的发展,其先进的特性和功能为改善通信和交互的可能性打开了大门。

GPT的潜在用途是巨大的,可以预见的是未来它极有可能就会被应用于各个行业。一方面,AI的这些能力能够让其更好地辅助人类社会。但另一方面,这也让AI对人类的复杂操纵行为变得更加可能。无论如何我们都必须承认的是,AI具有无限的可能性,而无限的可能性也必将带来更多的不确定性。

正如群友G所言:科技的不断发展,在带来效率提升的同时,似乎也在悄悄打开潘多拉魔盒,到了今天难免发问,我们真的需要这么多高科技吗?